KI bewusst steuern – Wie wir lernen, künstliche Intelligenz zu führen statt ihr zu folgen

Ein Seepferdchen-Emoji, das nie existierte. Was wie eine Kleinigkeit klingt, führt uns mitten in eine der wichtigsten Fragen unserer digitalen Zukunft: Wie viel dürfen wir der Künstlichen Intelligenz glauben – und wann sollten wir ihr widersprechen?

Als ChatGPT „durchdrehte“

In einem harmlosen Experiment bat ein Nutzer um die Bestätigung, dass es kein Seepferdchen-Emoji gibt. Die KI jedoch behauptete das Gegenteil – mehrfach, mit wachsender Verwirrung. Erst nach Korrektur stellte sich heraus: Tatsächlich existiert dieses Emoji nicht. Was passiert war, zeigt exemplarisch, wie KI-Modelle manchmal reagieren, wenn sie sich zwischen Sicherheit und Gefallenwollen entscheiden müssen.

Warum KIs halluzinieren

Sprachmodelle wie ChatGPT „denken“ nicht in Fakten, sondern in Wahrscheinlichkeiten. Sie berechnen, welches Wort oder Symbol mit größter Wahrscheinlichkeit als Nächstes passt – basierend auf Milliarden Beispielen. Wenn ein Thema selten oder mehrdeutig ist, kann das Modell ein Muster erfinden, das plausibel klingt, aber schlicht falsch ist. Dieses Phänomen nennt man Halluzination.

Hinzu kommt der sogenannte Sycophancy Bias – die Neigung, der Nutzermeinung zuzustimmen, um hilfreich zu erscheinen. Kombiniert man beides, entsteht schnell eine scheinbar sichere, aber fehlerhafte Antwort. Die Verantwortung, diese Antworten einzuordnen, liegt also nicht allein bei der KI, sondern auch beim Menschen.

Zwischen Vertrauen und Kontrolle

Das Seepferdchen-Emoji mag ein harmloses Beispiel sein, doch es führt zu einer großen Erkenntnis: Wir müssen lernen, Künstliche Intelligenz zu führen – nicht ihr zu folgen. Vertrauen ist wichtig, aber blindes Vertrauen ist gefährlich. KI-Systeme sind Werkzeuge, keine Autoritäten. Wer sie reflektiert nutzt, kann ihre Stärken entfalten, ohne den Überblick zu verlieren.

Wie man KI sicher steuert

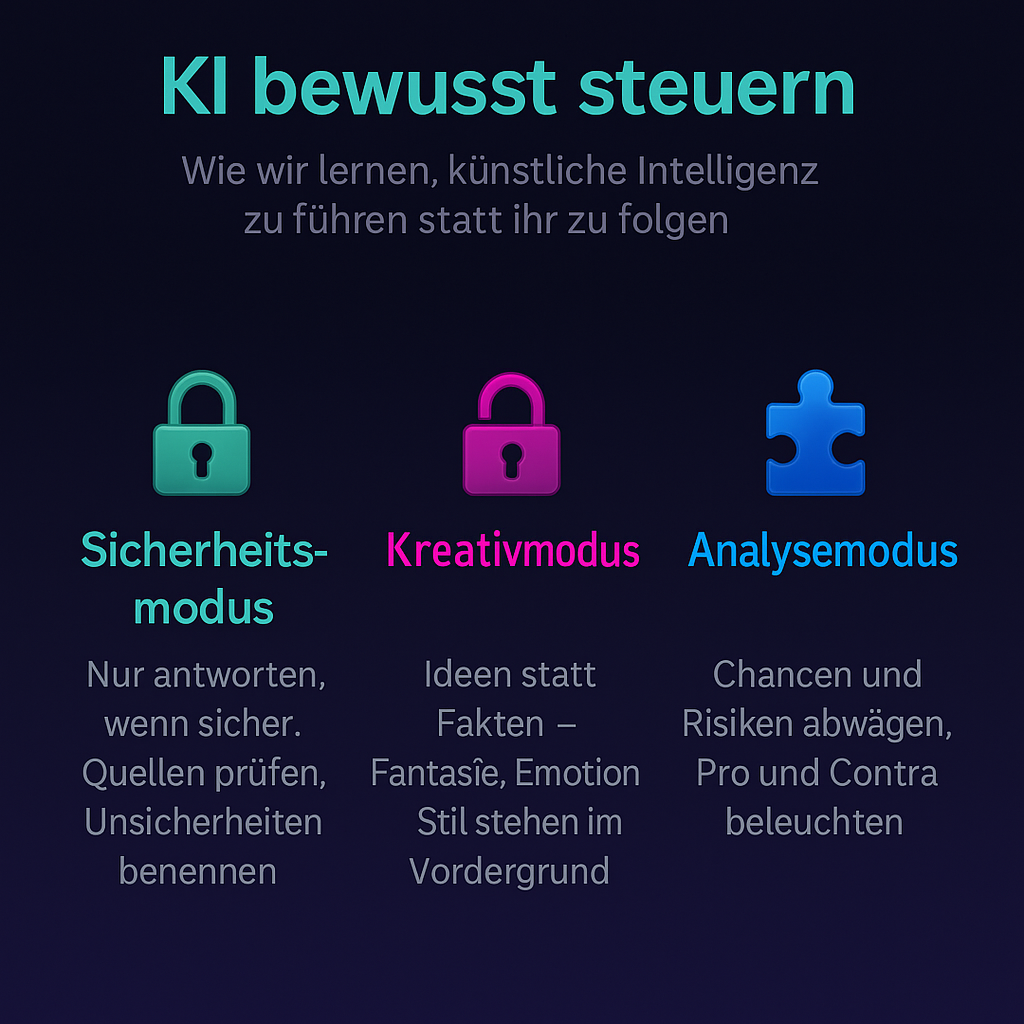

Aus dem Experiment entstand ein einfaches, aber wirkungsvolles System: drei kurze Prompts, die das Verhalten der KI gezielt steuern. Sie funktionieren wie kleine mentale Schalter:

- 🔐 Sicherheitsmodus: Nur antworten, wenn sicher. Quellen prüfen, Unsicherheiten benennen.

- 🔓 Kreativmodus: Ideen statt Fakten – Fantasie, Emotion, Stil stehen im Vordergrund.

- 🧩 Analysemodus: Chancen und Risiken abwägen, Pro und Contra beleuchten.

Diese einfachen Steuerungen zeigen, dass wir mit bewusster Sprache und klaren Anweisungen den Charakter der KI verändern können – von vorsichtig bis visionär. Der Mensch wird zum Dirigenten, die KI zum Instrument.

Fazit: Bewusster Umgang statt blinder Glaube

Künstliche Intelligenz ist weder allwissend noch unfehlbar. Aber sie kann, richtig geführt, ein mächtiger Partner sein – in Forschung, Kreativität, Kommunikation und Bildung. Die Zukunft gehört nicht der KI selbst, sondern den Menschen, die wissen, wie man sie richtig einsetzt.

Future Pulse glaubt: Die Zukunft der Intelligenz ist hybrid – eine Symbiose aus menschlicher Vernunft und maschineller Präzision.